EU AI Act, la loi qui encadre l'IA : Implications et orientations stratégiques

Temps de lecture : 5 minutes

L’intelligence artificielle connaît une adoption de plus en plus large à travers le monde, transformant des secteurs entiers et bouleversant les modes de fonctionnement des entreprises. En 2020, Gartner estimait que seulement 13 % des organisations se situaient dans la partie haute de son modèle de maturité en matière d’IA, mais cette proportion ne cesse de croître. Le Boston Consulting Group (BCG) souligne également dans son dernier rapport que ‘la plupart des entreprises à l’échelle mondiale font des progrès constants’ dans ce domaine. Face à cette montée en puissance de l’IA et à son impact croissant, la nécessité d’un cadre réglementaire devient primordiale. C’est dans ce contexte que l’Union européenne a introduit le Règlement sur l’intelligence artificielle, ou AI Act, qui vise à réguler le développement et l’utilisation de l’IA tout en protégeant les droits des citoyens européens.

Qu'est-ce que c'est, l’AI Act ?

Le Règlement sur l’intelligence artificielle de l’UE (AI Act) est une initiative législative destinée à réguler le développement et l’utilisation de l’IA dans les États membres. L’objectif est de créer un environnement sûr, fiable et équitable pour l’intégration de l’IA dans divers secteurs, tout en protégeant les citoyens européens des risques associés à cette technologie.

Pourquoi l’AI Act est-il crucial en Europe?

L’Europe se distingue par son approche centrée sur les droits humains et la protection des données personnelles. L’AI Act est crucial car il étend ces principes au domaine de l’intelligence artificielle, cherchant à prévenir les abus potentiels et à garantir que les technologies d’IA soient utilisées de manière éthique et responsable.

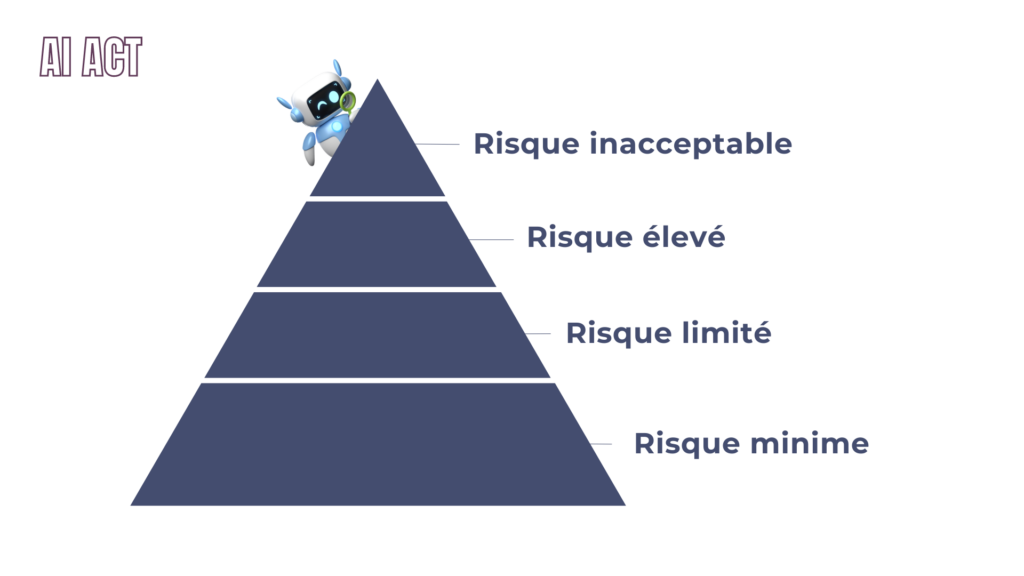

Classification des systèmes d’IA selon le risque

Les systèmes d’IA sont classés en quatre niveaux de risque : minimal, limité, élevé et inacceptable. Chaque niveau requiert des mesures de conformité proportionnelles à l’impact potentiel sur les citoyens et les entreprises.

- Risque minimal : Les systèmes d’IA à faible risque, tels que les filtres de spam ou les systèmes de recommandation, sont principalement exemptés d’obligations réglementaires. Ils ne nécessitent qu’une transparence de base, comme l’information aux utilisateurs sur l’utilisation de l’IA.

Risque limité : Les systèmes d’IA à risque limité, comme les chatbots ou certains outils de reconnaissance vocale, doivent respecter des exigences de transparence supplémentaires. Les utilisateurs doivent être informés qu’ils interagissent avec une IA.

Risque élevé : Les systèmes à risque élevé, tels que ceux utilisés dans les secteurs critiques comme la santé, les infrastructures ou la sécurité, sont soumis à des exigences strictes. Ces systèmes doivent faire l’objet d’une évaluation rigoureuse avant leur déploiement, incluant une gestion des risques, des audits de conformité, ainsi que la garantie de précision et de fiabilité.

Risque inacceptable : Les systèmes d’IA présentant un risque inacceptable, comme ceux utilisés pour la surveillance de masse ou la manipulation psychologique, sont interdits en raison de leur menace potentielle pour les droits fondamentaux et la sécurité publique.

Vous ne savez pas dans quel niveau de risque vous situer ? Faites le test dès maintenant.

Les défis et implications pour les entreprises

L’adoption de l’AI Act pose des défis significatifs pour les entreprises, notamment en termes de conformité et d’adaptation technologique.

Tandis que les grandes entreprises peuvent avoir les ressources nécessaires pour s’adapter rapidement, les startups pourraient trouver ces régulations comme un obstacle à l’innovation et à la croissance. Cependant, cela pourrait également représenter une opportunité pour se différencier par des pratiques d’IA éthiques et transparentes.

Stratégies de Conformité pour les Acteurs de l’IA

Les entreprises devront développer des stratégies de conformité, possiblement en intégrant des équipes dédiées à la gestion des risques d’IA et à la gouvernance des données, pour se conformer efficacement à l’AI Act.

Impact social et éthique de l'AI Act

L’impact de l’AI Act dépasse largement les implications techniques et commerciales ; il pose également des questions profondes sur le plan social et éthique, visant à protéger les droits fondamentaux des individus.

Au cœur de l’AI Act, la promotion d’un usage éthique de l’IA est essentielle. Cela comprend des garanties contre la discrimination, le respect de la vie privée, et l’assurance que les décisions automatisées soient justes, transparentes et susceptibles de recours humain en cas de besoin.

En imposant des normes élevées pour les systèmes d’IA, l’AI Act cherche à protéger les citoyens européens contre des abus potentiels tels que la surveillance de masse non réglementée ou les biais algorithmiques qui pourraient affecter leur vie de manière négative.

AI Act et innovation technologique

Bien que le cadre réglementaire puisse initialement sembler restrictif, il est conçu pour stimuler une innovation responsable et sécurisée dans le domaine de l’IA.

L’un des enjeux majeurs de l’AI Act est de parvenir à un équilibre entre la facilitation de l’innovation technologique et l’application des contrôles nécessaires pour prévenir les risques associés à l’IA. Ce défi est crucial pour maintenir la compétitivité de l’UE dans l’économie numérique mondiale, tout en assurant que l’innovation respecte les valeurs européennes.

Le cadre réglementaire de l’AI Act pourrait servir de catalyseur pour l’innovation, incitant les entreprises à développer des technologies d’IA qui ne sont pas seulement avancées mais aussi conformes à des standards éthiques élevés. Cela pourrait ouvrir de nouveaux marchés et opportunités pour les produits et services d’IA qui sont à la fois sécuritaires et éthiquement responsables.

Conclusion sur l'AI Act de l'UE

l’AI Act de l’UE est une initiative législative ambitieuse conçue pour encadrer l’utilisation de l’intelligence artificielle à travers une approche qui équilibre prudence réglementaire et encouragement de l’innovation. Bien que des défis subsistent, notamment en termes de mise en œuvre et d’impact sur les petites entreprises, les bénéfices potentiels en termes de protection des droits individuels et de promotion d’une IA éthique sont considérables.

Le Règlement AI Act est un cadre législatif important pour assurer que l’Europe reste à la pointe de l’innovation technologique tout en protégeant ses citoyens contre les risques potentiels de l’IA. Il s’agit d’une initiative qui pourrait bien modeler l’avenir de l’IA globalement.

Pour les entreprises, les décideurs, et les citoyens européens, il est essentiel de rester informés sur les développements de l’AI Act, de participer aux discussions et de préparer activement les adaptations nécessaires pour maximiser les avantages de l’IA tout en minimisant ses risques.